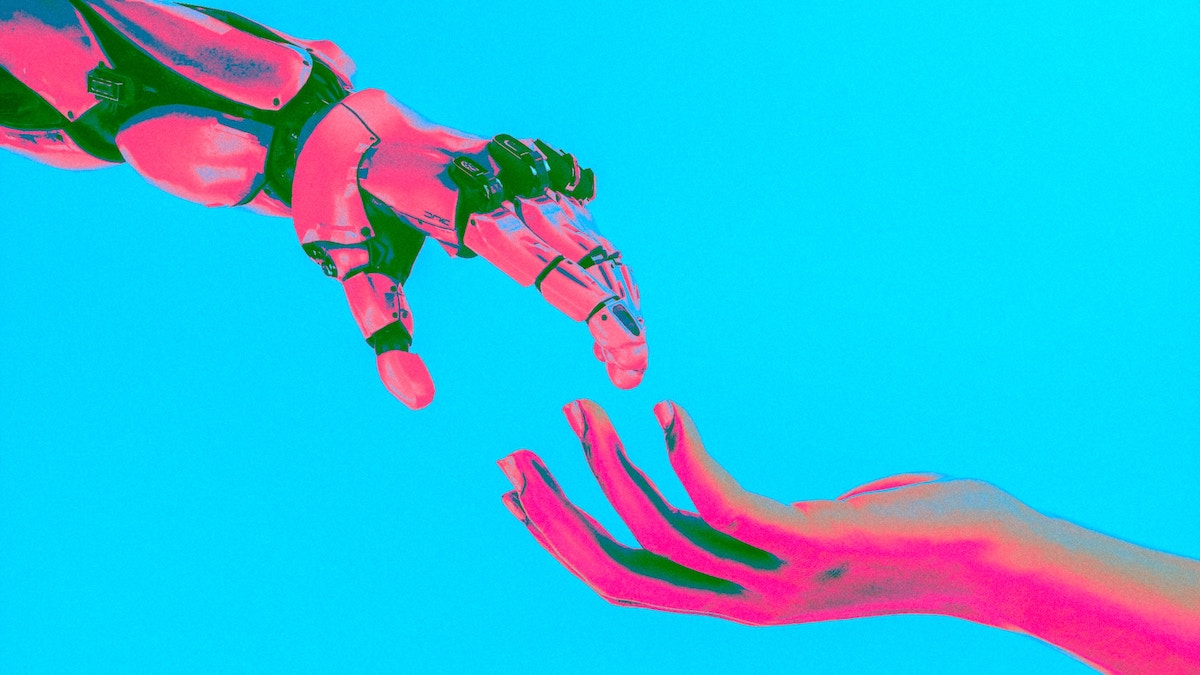

Quella del parlamento europeo è stata una decisione storica. L’Ue ha introdotto la prima regolamentazione sull’intelligenza artificiale, un pacchetto di leggi che entrerà in vigore – nella sua interezza – entro la metà del 2026. “Non ci accontentiamo più di soft law, di strumenti di accordo politico, ma abbiamo messo delle regole di mercato”, spiega a The Hollywood Reporter Roma l’eurodeputato del Pd Brando Benifei (gruppo S&D, socialisti e democratici), che insieme al parlamentare Dragos Tudorache di Renew è stato tra i promotori dell’Ai Act, approvato il 13 marzo.

La nuova regolamentazione propone una serie di leggi basate sul rischio dei modelli di intelligenza artificiale (da “basso rischio” a “rischio sistemico”, come GPT4 di OpenAI e Gemini di Google), classificando questi strumenti in base al danno potenziale che potrebbero causare. Con la messa al bando di formule che comportano “rischi inaccettabili”, per esempio l’uso di dati biometrici per rilevare l’orientamento sessuale o l’etnia di una persona.

Sono banditi anche tutti i sistemi di social scoring, cioè di punteggio sociale (come si vede in una famosa puntata di Black Mirror, e come avviene in Cina), cioè la valutazione del comportamento e della reputazione dei cittadini. Ma anche il divieto di giustizia predittiva, un tema di tutela dello stato di diritto e della presunzione di innocenza, una scelta che mette in difficoltà Giove, il software di polizia predittiva in sviluppo nelle procure italiane.

L’effetto Bruxelles

“Questo documento influenzerà il dibattito internazionale, c’è grande attenzione sull’Ai Act”, aggiunge Benifei, sottolineando la sua speranza nel cosiddetto “Brussels effect”, cioè l’effetto domino che le leggi europee hanno sul mondo globalizzato. “Speriamo che questa legge influenzi sia il comportamento degli sviluppatori delle intelligenze artificiali sia le scelte normative dei vari paesi del mondo, come è avvenuto con il Gdpr”.

Sul diritto d’autore, l’Ai Act impone alle aziende di IA di rispettare la legge europea sul copyright e sulla protezione dei dati. Un sospiro di sollievo arriva dai creativi, che dall’uscita delle IA generative hanno subito il “cyberfurto” della loro arte attraverso lo scraping, cioè la raccolta indiscriminata di dati dal web per allenare i modelli di intelligenza artificiale.

Sull’argomento si è espresso anche Lorenzo Ceccotti, in arte LRNZ, artista e autore di fumetti, nonché sostenitore della regolamentazione sull’IA attraverso la piattaforma Egair (European Guild for Artificial Intelligence Regulation).

“Nel testo leggiamo per la prima volta, e nero su bianco, l’obbligo per le aziende di AI di rispettare il copyright e la volontà degli autori quando addestrano i loro modelli,” ha affermato a THR Roma, aggiungendo però che il testo “non è ancora perfetto”, e che “molta della sua efficacia dipenderà da come verrà messo in pratica dall’AI Office e dai governi nazionali”.

Opt-in, opt-out

Egair, infatti, si batteva per un sistema di cosiddetto opt-in, la libera iscrizione degli artisti stessi ai database con cui vengono allenate le IA. La regolamentazione approvata, però, prevede invece un sistema di opt-out, cioè di disiscrizione da questi database qualora fossero presenti opere d’arte utilizzate senza consenso.

“Nel regolamento c’è l’obbligo di trasparenza da parte degli sviluppatori, devono pubblicare un riassunto dettagliato sui dataset che sono stati utilizzati per allenare i loro modelli”, spiega l’eurodeputato. “In questo modo i detentori del diritto d’autore possono verificare se le loro opere sono state utilizzate senza la loro autorizzazione, applicando quindi l’opt-out”.

Intelligenza artificiale e deep fake

L’Ai Act si scaglia anche contro i deep fake, ovvero video generati dall’intelligenza artificiale che ritraggono persone reali. A inizio marzo, la Commissione europea ha chiesto alle big tech come Meta e TikTok di pubblicare informazioni sulle misure di attenuazione dei rischi legati all’IA, in vista delle elezioni europee di giugno, ai sensi del Digital Service Act (Dsa). Quest’azione però agisce sulle piattaforme che possono essere principale veicolo della disinformazione.

Il testo approvato dall’europarlamento il 13 marzo agisce invece all’origine. “La nostra previsione di regolamento etichetterà tutti i contenuti realizzati con IA generativa attraverso un watermark invisibile, una ‘firma’, che permette ai dispositivi di rilevare quando un contenuto è stato manipolato attraverso l’IA”, spiega Benifei.

In vista delle elezioni, continua l’eurodeputato di S&D, quello che viene chiesto alle aziende è un’applicazione “volontaria anticipata delle nostre norme”. E conclude: “Regolamentare l’intelligenza artificiale è una questione di democrazia”.

THR Newsletter

Iscriviti per ricevere via email tutti gli aggiornamenti e le notizie di THR Roma